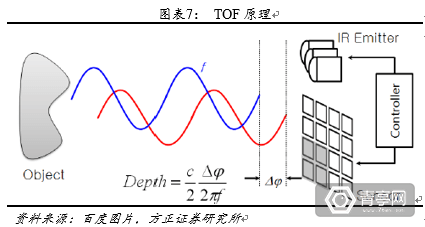

Time of Flight��һ������ʽ��ȸ�Ӧ��������ÿ�����ص㣬���˼�¼����ǿ����Ϣ֮�⣬Ҳ��¼�������ߴӹ�Դ�������ص��ʱ�䣨��Time of Flight����������װ�÷�������⣬ͬʱ����Ŀ����ķ���⣬���ɲ���ʱ������Ŀ����ľ��롣

����ͼ��ʾ���������岨�ε�Ƶ��Ϊf�������뷢�����岨�ε���λƫ����φ����φ/2πfΪ���岨��������������ʱ�䡣�ù���c����ʱ������Եõ��������롣

2��TOF����ʵ��

TOF��Ӳ��ʵ�ַ�ʽ�ͽṹ�����ƣ�����ֻ�������㷨�ϣ��ṹ����ñ�����Ĺ�pattern����Ͷ�䣬��TOFֱ�Ӽ�����λ�

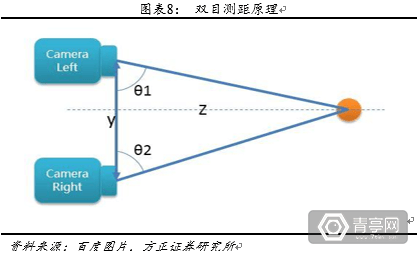

1.3.3 ˫Ŀ��࣬��ͳ��3D��֪����

˫Ŀ���ԭ�������˵�˫�ۣ�����Ȼ����ͨ����������ͷץȡͼ��ͨ��������ԭ�������㲢��������Ϣ��Ŀǰ��˫�����˫Ŀ���ĵ���Ӧ�á�

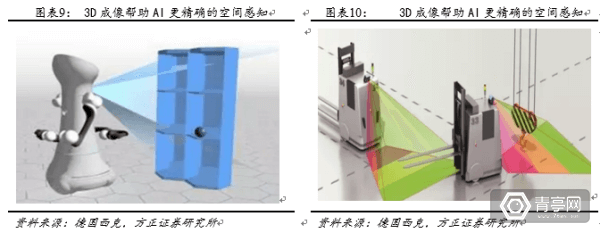

1.4 3D�����ǿ���AI��ARʱ���ĸ�֪Կ��

��AI�Ļ����Ӿ�Ϊ����Ŀǰ������2Dͼ����ͨ���㷨ʵ������ʶ�𣬵�������2Dͼ������������Ϣ���ޣ���ʹ�㷨���Ƚ���������Ϣ����Ϊ���ܻ��Ķ̰壬����ܹ���ȫ�����ά��Ϣ��ÿ���������ά������������������Ϊ���ʶ�������������켣��ʶ���AIӦ��������ͬ���ģ�ARӦ����3D����Ҳ�DZز����١�

2 3D����������һ�ֹ�ѧ�����˳�

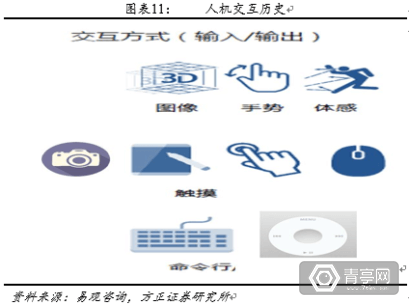

2.1 ��������ά����������ռ��

�ݹ��˻���������ʷ�����ָ�����DOSϵͳ+�����γ�������һά�˻�������Windows+���Ķ�ά������ʽ�����˻�����/PCʱ����������������ͷ�Ķ�ά������ʽ�������ƶ�������/�����ֻ�ʱ������������ARΪ��������һ������ƽ̨������Ҫ��ά�Ľ�����ʽ��

���ƶ�������ʱ����������������ͷ��Ϊ��Ҫ���˻�����ý�顣���������Է����ʵ�ָ��ֲ�������ȼ��̺�����Ϊ��Ȼ��˳��������ͷʵ���˴������������룬Ҳ��һ����Ҫ���˻�����ý�顣

��������������ͷ������2D�Ľ�����ʽ���ڴ������ϣ�����ֻ��ʵ��ƽ��

���濵�� ���˹ھ������������������������

��˵���𣿰��˹ھ�Ҫ���ճ����� ������������������Կ����� ȷ����Ϣ�������£����գ������ڿ������μ����ھ��� �������վ�����������������ô���£��վ�������������˵��ʲô

����˹��ͳ�վ�15����Ī˹��������������Ժ������������ʱ��ʾ�����Ϲ�������5���������¹���ȷ�����������ȶ�����;������Щ�������ں�ƻ������ô���£�������Ϊʲô�ں�ƻ��

1��15����Ϣ���ݹ���ý�屨��������ʱ���ܶ����������ں�ƻ����������ͳ��������Twitter�ϱ�Թƻ���ܾ�����ִ�����������ӷ�iPho������ȫ���ְ����ô���£�������Ϊʲôȫ���ְ

�ݶ���˹����������������ʱ��15�գ�����˹����÷��Τ�ܷ�����������ȫ���ְ���Ժ����˹��ͳ�վ���ʾ����������������ȫίCopyright © 2016�������� ��Ȩ����.

MIDOO.CC, All Rights Reserved. �����ţ�ԥICP��15012166��-2